Los riesgos y los siguientes pasos con la I.A.

Concluimos la reseña del Future Talent Forum.

Con la entrega de hoy, continúo el resumen del Future Talent Forum al que asistí el miércoles pasado en la Universidad de la Libertad, con el tema de la I.A. y su disrupción en empleos y escuelas. Quiero agradecer la invitación que me hizo el Future Talent Council a este evento, por cierto.

Comentaba con el profesor Finchetti los tres grandes riesgos que la adopción inadecuada de la inteligencia artificial puede causar, y que urge adecuar los marcos legales para reconocerlos:

Si la prueba maestra en los juicios penales era el video (sí, los documentos son clave; pero es difícil que alguien ponga por escrito una amenaza real a la vida de otra persona o la confesión de un robo, por ejemplo) y ahora cualquiera puede generar videos realistas usando I.A., necesitaremos reescribir las leyes.

El tema de incluir como referencias las consultas a la I.A., cuando son tan cambiantes y aprenden constantemente; ninguna consulta dará el mismo resultado que otra, aunque se haga en el mismo modelo prácticamente al mismo tiempo. Eso hará que la reproducibilidad de la ciencia se pierda mucho.

El asunto de los derechos de autor. Si un texto se escribe con ayuda de I.A., ¿quién es el verdadero autor? ¿Cómo determinar quién firma el texto? ¿Es el autor el del texto final, es quien mejores prompts diseña, o se debe considerar un porcentaje de texto humano para validarlo?

Luego de las mesas de trabajo, pasamos a la sesión plenaria sobre el “nuevo sistema operativo humano”. Si podemos delegar tantas tareas repetitivas o que requieren mucho esfuerzo a las máquinas, ¿cuál deberá ser la nueva tarea de las personas?

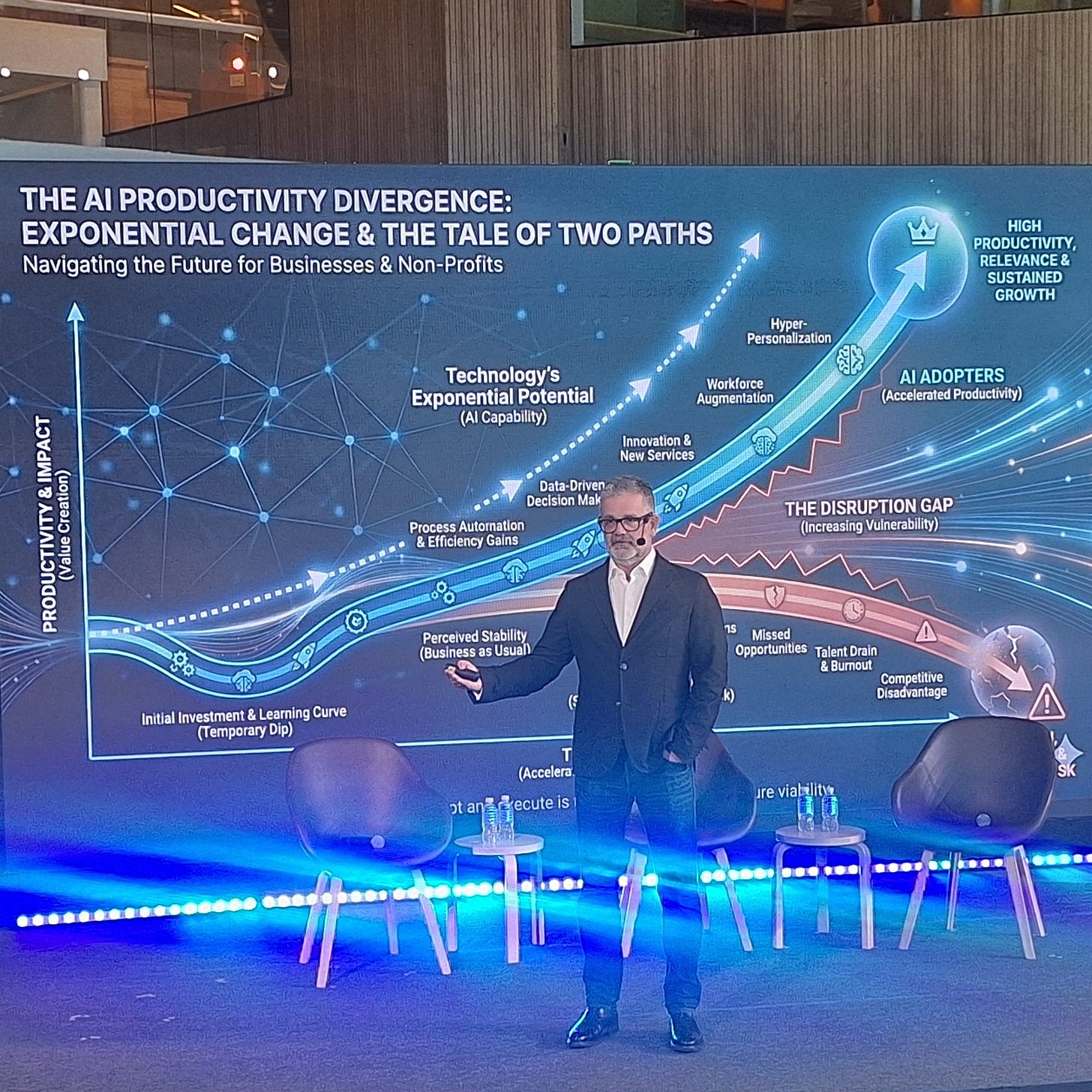

En esa mesa, Ben Nelson, el director de Minerva Project, enfatizó tres cosas: las máquinas pueden hacer mucho más en menos tiempo que nosotros. Pero requieren ser adecuadamente entrenadas y hacerles las preguntas correctas. “Antes, hacer una presentación para una conferencia como esta podía tomarme un par de días, más otros dos días con el equipo de diseño. No me apena decirles que la presentación de hoy la hice durante el vuelo, y esta lámina completa tomó menos de cuatro minutos, tres de ella describiendo qué quería que buscara de referencias, qué quería que dijera y qué aspecto final debería tener. Y es la mejor lámina que he presentado en conferencia alguna. Ahora la duda es: ¿qué hacer en nuestro tiempo libre?”.

El tema es que, como bien señala Nelson, habrá dos rutas: una para los que diseñen, desarrollen y adapten adecuadamente estas tecnologías; otra para los que no las consideren, las limiten o no aprendan a usarlas. E incluso, para quienes las usen mal. Un médico podrá apoyar sus diagnósticos y seguimientos con I.A., pero si se deja reemplazar por ellas, perderá mucho más de lo que gana. “Lo que estas herramientas no podrán desplazar es el toque humano. Podrán compilar y analizar gran capacidad de información, pero no podrán sentir empatía ni ninguna otra emoción. Debemos enfatizar el ser humanos con nuestros colegas. Eso no puede reemplazarse”.

Avisos parroquiales.

Mañana toca tener aquí invitada de lujo, Cruz González. Y yo publicaré en su Substack. También habrá texto para los suscriptores de paga, martes por la tarde. El miércoles vendremos con el último texto y conclusiones sobre el Future Talent Forum. Jueves, toca podcast. Un día más y acabamos la semana. Y llegamos a la mitad de febrero. No, bueno.

Les recuerdo que, si reciben este texto por correo, pueden mandarme sus comentarios o sugerencias respondiendo el correo. No se apuren, solo me llega a mí, no se va a la lista completa. Si me leen en Substack, pueden empezar a seguirme y mandarme mensajes directos por la app. Y también son bienvenidos a suscribirse.

Reescribir leyes,

médicos robóticos;

no hay toque humano.